L’essentiel

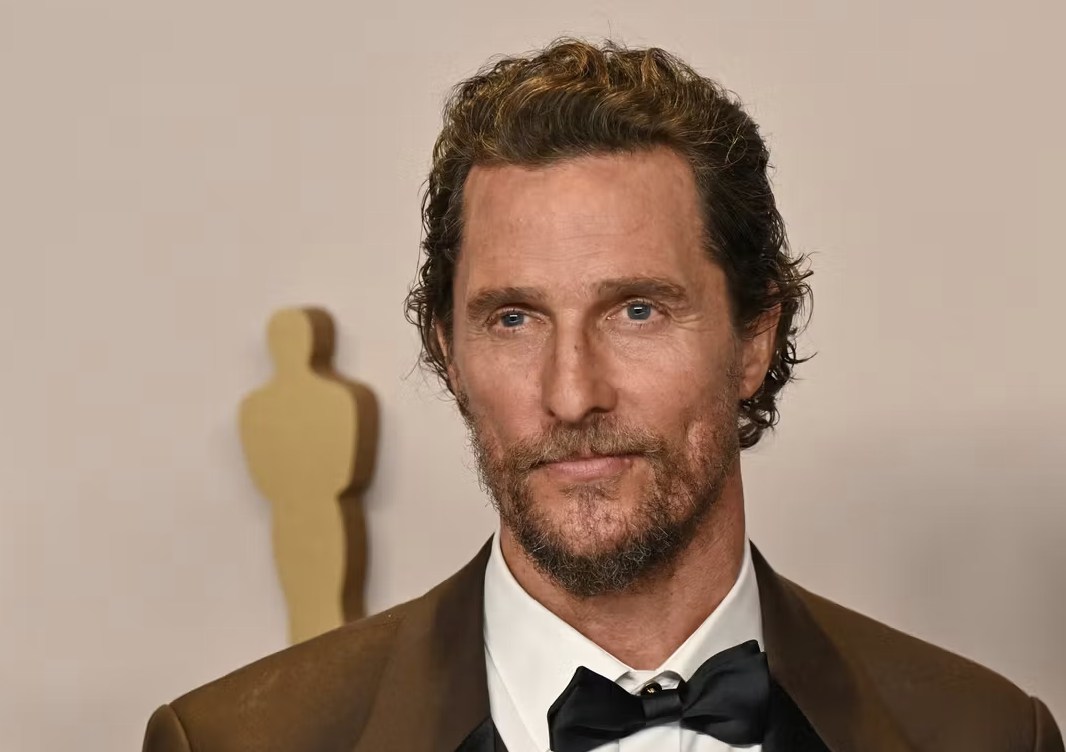

Matthew McConaughey annonce avoir « déposé » son image et sa voix auprès de l’office américain de la propriété intellectuelle afin d’anticiper leur utilisation par des intelligences artificielles. Cette démarche ne correspond pas à un brevet au sens du droit français, mais à une stratégie de prévention et de preuve.

Elle relance une question clé pour les artistes européens : peut-on protéger sa voix et son image contre l’IA générative de la même manière en France ? Le droit français offre déjà des protections solides, mais leur mise en œuvre se heurte à des limites pratiques, notamment en matière de preuve et d’identification des responsables.

Ce que Matthew McConaughey a fait concrètement

Aux États-Unis, Matthew McConaughey a fait enregistrer, auprès de l’office américain de la propriété intellectuelle, des extraits vidéo de son image ainsi que des enregistrements de sa voix. L’objectif est de disposer d’une référence officielle, clairement datée et documentée, à opposer en cas d’usage non autorisé par une intelligence artificielle.

Contrairement à ce que pourrait laisser penser l’expression « dépôt » dans le langage courant, il ne s’agit pas d’un brevet d’invention ni d’un monopole comparable à celui reconnu en matière de propriété industrielle. La démarche vise plutôt à organiser la preuve de ce qu’est l’image et la voix authentiques de l’acteur, afin de pouvoir réagir plus vite contre le clonage vocal ou les deepfakes qui exploiteraient son identité sans autorisation.

Cette stratégie s’inscrit dans un contexte américain où certains États fédérés commencent à adopter des lois spécifiques sur l’utilisation de l’image et de la voix par l’IA, et où plusieurs artistes ont déjà été confrontés à des imitations réalistes, diffusées à grande échelle sur les plateformes numériques.

Peut-on faire la même chose en France ?

En France, il n’est pas possible de breveter sa voix ou son image. Le brevet est réservé aux inventions techniques, qui doivent répondre à des critères stricts de nouveauté, d’activité inventive et d’application industrielle. Une voix ou une image, en tant que telles, n’entrent pas dans cette catégorie.

Cela ne signifie pas pour autant que la voix et l’image ne sont pas protégées. Elles font partie des attributs de la personnalité et bénéficient, à ce titre, d’une protection forte en droit français, sans qu’aucun dépôt préalable ne soit requis. Il n’est donc pas nécessaire de « déposer » sa voix ou son image pour pouvoir agir.

En pratique, toute utilisation de l’image ou de la voix d’une personne sans son accord peut être contestée, y compris lorsqu’elle résulte d’un traitement par intelligence artificielle. Le consentement de la personne concernée reste la règle centrale, que l’exploitation soit réalisée à partir d’un enregistrement réel ou d’une imitation générée par un modèle d’IA.

Les principaux outils juridiques disponibles en France

Face aux usages de l’IA générative, plusieurs leviers juridiques peuvent être mobilisés pour protéger la voix et l’image d’une personne.

Le droit à l’image et à la voix. Chacun dispose d’un droit exclusif sur son image et, par extension, sur les éléments de sa personnalité qui permettent son identification, comme sa voix. Nul ne peut utiliser l’apparence ou la voix d’une personne sans autorisation, que cette utilisation soit directe (diffusion d’un enregistrement) ou indirecte (deepfake vidéo, clonage vocal réaliste). En cas d’atteinte, la personne peut demander la cessation de l’utilisation litigieuse et obtenir, le cas échéant, des dommages et intérêts.

Les droits des artistes interprètes. Lorsqu’il s’agit d’un artiste, son interprétation et sa prestation sont protégées par des droits voisins du droit d’auteur. Toute fixation, reproduction ou communication au public de cette prestation suppose, en principe, son autorisation. Une imitation artificielle très proche d’une prestation identifiée peut ainsi soulever la question d’une atteinte aux droits de l’artiste interprète, qui peut s’opposer à certaines exploitations ou revendiquer une rémunération.

Le RGPD et la protection des données personnelles. La voix et l’image peuvent constituer des données à caractère personnel, voire des données biométriques lorsqu’elles permettent d’identifier une personne de manière unique. Leur collecte, leur conservation et leur utilisation par une IA supposent alors une base légale claire (consentement, contrat, intérêt légitime…), une finalité déterminée, une information transparente des personnes concernées et le respect de leurs droits (accès, rectification, opposition, effacement, etc.). Les acteurs qui entraînent ou exploitent des modèles d’IA sur des données vocales ou visuelles doivent être en mesure de démontrer cette conformité.

Est-ce vraiment efficace face à l’IA générative ?

Sur le plan des principes, le droit français dispose déjà de fondements pour contester l’exploitation non autorisée de la voix ou de l’image d’une personne par une IA. Le principal obstacle n’est donc pas l’absence de règles, mais leur mise en œuvre concrète.

La première difficulté tient à la preuve. Il peut être complexe de démontrer qu’une voix ou une image générée imite suffisamment une personne déterminée pour porter atteinte à ses droits. Les critères de ressemblance, de confusion ou de parasitisme peuvent faire l’objet de discussions, en particulier si l’imitation est partielle, stylisée ou combinée à d’autres éléments fictifs.

La deuxième difficulté concerne l’identification des responsables. Entre le concepteur du modèle, les services qui le mettent à disposition, les intermédiaires techniques et les plateformes de diffusion, la chaîne d’acteurs est souvent longue et fragmentée. Identifier celui ou ceux contre qui agir, et dans quel ordre, nécessite parfois une analyse technique et juridique approfondie.

Le futur règlement européen sur l’intelligence artificielle devrait renforcer la transparence de certains systèmes, par exemple en imposant des informations spécifiques pour les modèles d’IA générative ou pour les contenus synthétiques. Ces obligations pourront faciliter l’identification des acteurs et la traçabilité des usages. Elles ne supprimeront toutefois pas tous les risques d’abus, ni les obstacles pratiques liés à la preuve, à la localisation des responsables ou à l’exécution des décisions de justice.

Ce qu’il faut retenir

- La démarche de Matthew McConaughey ne correspond pas à un brevet sur sa voix ou son image, mais à une stratégie de prévention et de preuve face au clonage vocal et aux deepfakes.

- En France, il n’est pas possible de déposer ou breveter sa voix et son image, mais celles-ci sont déjà protégées par le droit à l’image, les droits des artistes interprètes et le RGPD.

- Les principaux défis ne tiennent pas à l’absence de règles, mais aux difficultés de preuve et d’identification des responsables dans les chaînes techniques de l’IA générative.

Conclusion

La décision de Matthew McConaughey de formaliser l’enregistrement de son image et de sa voix face à l’IA est avant tout un geste symbolique et stratégique, adapté au contexte américain. En France, la protection juridique de la voix et de l’image existe déjà, sans dépôt préalable, mais elle suppose de se préparer, de documenter les usages et d’agir de manière organisée et réactive lorsqu’apparaissent des contenus générés ou diffusés sans autorisation.